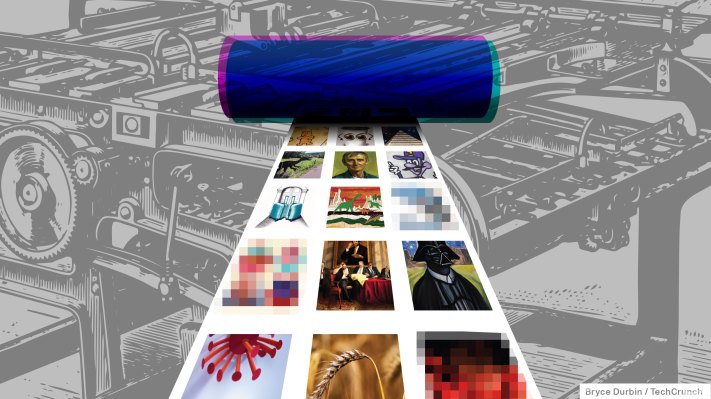

今年對於人工智慧最大的話題來自於自我生成藝術,像是 9 月下旬公開的 DALL-E 2 與 Stable Diffusion ,展現極為突出的視覺能力,另外一方面,我們也看到 AI 生成影像已經占據視覺版面,像是微軟 Office 就發表未來能夠應用到文書編輯軟體。

一連串的技術突破雖然讓人非常興奮,不過,從 Vox 報導中也看到其他層面的影響:生成圖像多數採用英文,也就是西方世界的語言表現方式,連結到視覺圖像也會偏向西方邏輯。比如說如果我們使用東方文字例如禪(Zen)或是山水畫,結果其實不如人們預期。

上一代 DALL-E 也出現類似現象,若要人工智慧繪製律師,出現的是白人男性;繪製空服員則會跑出女性的刻板印象。受到網路上民意發展,Open AI 從善如流持續調整模型,現在雖然看不太到性別或是職業歧視,仍然受到西方世界影像頗深,這點一時半刻還未能解決。這讓人思考,如果 AI 所使用的資料集幾乎都來自於西方的話,會不會成為一種所謂的殖民價值觀?答案可能讓人非常意外。

與其說人工智慧是一種工具,不如說它容易讓「偏誤」成為某種可以被模擬的參數環境。舉例來說,某間大學教授上到1950-60 年代洛可可時期風景畫,課後作業請學生使用 Stable Diffusion 繪製圖畫,成果跟迪士尼動畫背景長得非常類似。所以資料集的時間軸、方法、文化與社會結構,都有可能會影響繪製成果。

這也是為什麼我們需要討論西方與東方的差別。

在 MIT 研究人工智慧的 Yilun Du 就認為,既有資料的偏誤不容易從 AI 模型中移除,所有的演算法或多或少已經成為偏誤的來源。「過去 25 年間生存於髒水的果樹,即使現在用乾淨水源灌溉,長出來也是帶著髒水的果實」她說。形容同樣 AI 模型不容易因使用新資料,就能夠得出新結果,是再好也不過的譬喻。擔任卡內基美隆機器人研究所副教授的 Jean Oh,也認為現在使用的 AI 模型本身並不完整,我們是使用之後才能夠漸漸調整模型本身,這也讓我們去思考更深層的人類、科技、社會與文化問題。

要完全排除偏誤相當困難,就如人類本身也是每天修正自己思考不確實的地方,如此對話值得多多進行,至少可能走在「相對」正確的道路上。